缓存更新的套路

看到好些人在写更新缓存数据代码时,先删除缓存,然后再更新数据库,而后续的操作会把数据再装载的缓存中。然而,这个是逻辑是错误的。试想,两个并发操作,一个是更新操作,另一个是查询操作,更新操作删除缓存后,查询操作没有命中缓存,先把老数据读出来后放到缓存中,然后更新操作更新了数据库。于是,在缓存中的数据还是老的数据,导致缓存中的数据是脏的,而且还一直这样脏下去了。

看到好些人在写更新缓存数据代码时,先删除缓存,然后再更新数据库,而后续的操作会把数据再装载的缓存中。然而,这个是逻辑是错误的。试想,两个并发操作,一个是更新操作,另一个是查询操作,更新操作删除缓存后,查询操作没有命中缓存,先把老数据读出来后放到缓存中,然后更新操作更新了数据库。于是,在缓存中的数据还是老的数据,导致缓存中的数据是脏的,而且还一直这样脏下去了。

我不知道为什么这么多人用的都是这个逻辑,当我在微博上发了这个贴以后,我发现好些人给了好多非常复杂和诡异的方案,所以,我想写这篇文章说一下几个缓存更新的Design Pattern(让我们多一些套路吧)。

这里,我们先不讨论更新缓存和更新数据这两个事是一个事务的事,或是会有失败的可能,我们先假设更新数据库和更新缓存都可以成功的情况(我们先把成功的代码逻辑先写对)。

更新缓存的的Design Pattern有四种:Cache aside, Read through, Write through, Write behind caching,我们下面一一来看一下这四种Pattern。

目录

Cache Aside Pattern

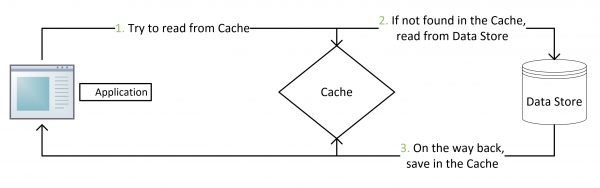

这是最常用最常用的pattern了。其具体逻辑如下:

- 失效:应用程序先从cache取数据,没有得到,则从数据库中取数据,成功后,放到缓存中。

- 命中:应用程序从cache中取数据,取到后返回。

- 更新:先把数据存到数据库中,成功后,再让缓存失效。

注意,我们的更新是先更新数据库,成功后,让缓存失效。那么,这种方式是否可以没有文章前面提到过的那个问题呢?我们可以脑补一下。

一个是查询操作,一个是更新操作的并发,首先,没有了删除cache数据的操作了,而是先更新了数据库中的数据,此时,缓存依然有效,所以,并发的查询操作拿的是没有更新的数据,但是,更新操作马上让缓存的失效了,后续的查询操作再把数据从数据库中拉出来。而不会像文章开头的那个逻辑产生的问题,后续的查询操作一直都在取老的数据。

这是标准的design pattern,包括Facebook的论文《Scaling Memcache at Facebook》也使用了这个策略。为什么不是写完数据库后更新缓存?你可以看一下Quora上的这个问答《Why does Facebook use delete to remove the key-value pair in Memcached instead of updating the Memcached during write request to the backend?》,主要是怕两个并发的写操作导致脏数据。

那么,是不是Cache Aside这个就不会有并发问题了?不是的,比如,一个是读操作,但是没有命中缓存,然后就到数据库中取数据,此时来了一个写操作,写完数据库后,让缓存失效,然后,之前的那个读操作再把老的数据放进去,所以,会造成脏数据。

但,这个case理论上会出现,不过,实际上出现的概率可能非常低,因为这个条件需要发生在读缓存时缓存失效,而且并发着有一个写操作。而实际上数据库的写操作会比读操作慢得多,而且还要锁表,而读操作必需在写操作前进入数据库操作,而又要晚于写操作更新缓存,所有的这些条件都具备的概率基本并不大。

所以,这也就是Quora上的那个答案里说的,要么通过2PC或是Paxos协议保证一致性,要么就是拼命的降低并发时脏数据的概率,而Facebook使用了这个降低概率的玩法,因为2PC太慢,而Paxos太复杂。当然,最好还是为缓存设置上过期时间。

Read/Write Through Pattern

我们可以看到,在上面的Cache Aside套路中,我们的应用代码需要维护两个数据存储,一个是缓存(Cache),一个是数据库(Repository)。所以,应用程序比较啰嗦。而Read/Write Through套路是把更新数据库(Repository)的操作由缓存自己代理了,所以,对于应用层来说,就简单很多了。可以理解为,应用认为后端就是一个单一的存储,而存储自己维护自己的Cache。

Read Through

Read Through 套路就是在查询操作中更新缓存,也就是说,当缓存失效的时候(过期或LRU换出),Cache Aside是由调用方负责把数据加载入缓存,而Read Through则用缓存服务自己来加载,从而对应用方是透明的。

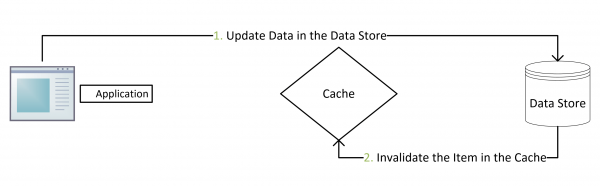

Write Through

Write Through 套路和Read Through相仿,不过是在更新数据时发生。当有数据更新的时候,如果没有命中缓存,直接更新数据库,然后返回。如果命中了缓存,则更新缓存,然后再由Cache自己更新数据库(这是一个同步操作)

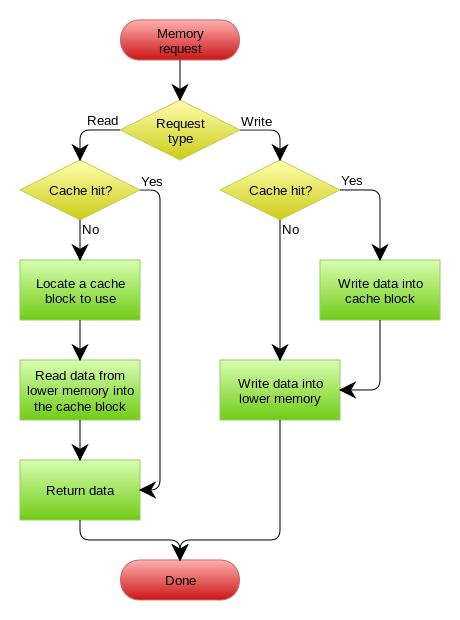

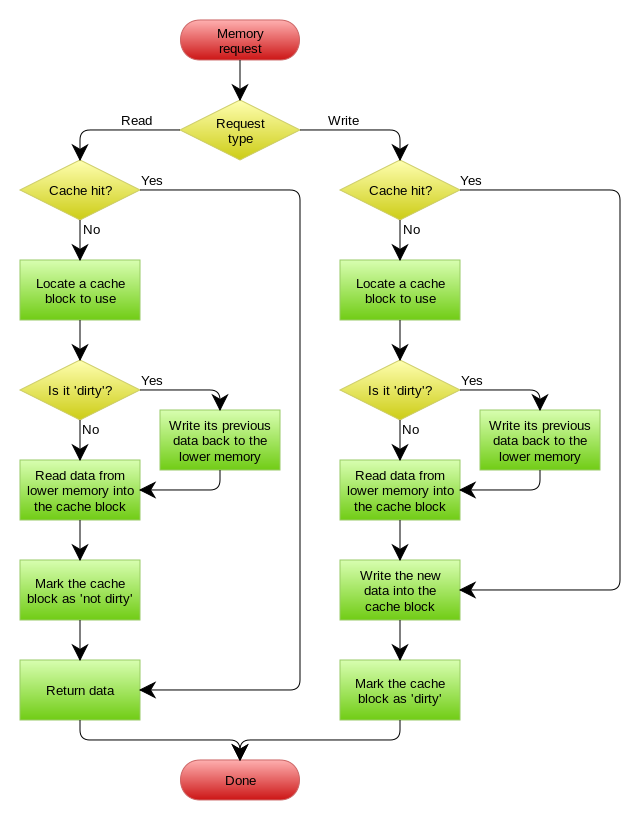

下图自来Wikipedia的Cache词条。其中的Memory你可以理解为就是我们例子里的数据库。

Write Behind Caching Pattern

Write Behind 又叫 Write Back。一些了解Linux操作系统内核的同学对write back应该非常熟悉,这不就是Linux文件系统的Page Cache的算法吗?是的,你看基础这玩意全都是相通的。所以,基础很重要,我已经不是一次说过基础很重要这事了。

Write Back套路,一句说就是,在更新数据的时候,只更新缓存,不更新数据库,而我们的缓存会异步地批量更新数据库。这个设计的好处就是让数据的I/O操作飞快无比(因为直接操作内存嘛 ),因为异步,write backg还可以合并对同一个数据的多次操作,所以性能的提高是相当可观的。

但是,其带来的问题是,数据不是强一致性的,而且可能会丢失(我们知道Unix/Linux非正常关机会导致数据丢失,就是因为这个事)。在软件设计上,我们基本上不可能做出一个没有缺陷的设计,就像算法设计中的时间换空间,空间换时间一个道理,有时候,强一致性和高性能,高可用和高性性是有冲突的。软件设计从来都是取舍Trade-Off。

另外,Write Back实现逻辑比较复杂,因为他需要track有哪数据是被更新了的,需要刷到持久层上。操作系统的write back会在仅当这个cache需要失效的时候,才会被真正持久起来,比如,内存不够了,或是进程退出了等情况,这又叫lazy write。

在wikipedia上有一张write back的流程图,基本逻辑如下:

再多唠叨一些

1)上面讲的这些Design Pattern,其实并不是软件架构里的mysql数据库和memcache/redis的更新策略,这些东西都是计算机体系结构里的设计,比如CPU的缓存,硬盘文件系统中的缓存,硬盘上的缓存,数据库中的缓存。基本上来说,这些缓存更新的设计模式都是非常老古董的,而且历经长时间考验的策略,所以这也就是,工程学上所谓的Best Practice,遵从就好了。

2)有时候,我们觉得能做宏观的系统架构的人一定是很有经验的,其实,宏观系统架构中的很多设计都来源于这些微观的东西。比如,云计算中的很多虚拟化技术的原理,和传统的虚拟内存不是很像么?Unix下的那些I/O模型,也放大到了架构里的同步异步的模型,还有Unix发明的管道不就是数据流式计算架构吗?TCP的好些设计也用在不同系统间的通讯中,仔细看看这些微观层面,你会发现有很多设计都非常精妙……所以,请允许我在这里放句观点鲜明的话——如果你要做好架构,首先你得把计算机体系结构以及很多老古董的基础技术吃透了。

3)在软件开发或设计中,我非常建议在之前先去参考一下已有的设计和思路,看看相应的guideline,best practice或design pattern,吃透了已有的这些东西,再决定是否要重新发明轮子。千万不要似是而非地,想当然的做软件设计。

4)上面,我们没有考虑缓存(Cache)和持久层(Repository)的整体事务的问题。比如,更新Cache成功,更新数据库失败了怎么吗?或是反过来。关于这个事,如果你需要强一致性,你需要使用“两阶段提交协议”——prepare, commit/rollback,比如Java 7 的XAResource,还有MySQL 5.7的 XA Transaction,有些cache也支持XA,比如EhCache。当然,XA这样的强一致性的玩法会导致性能下降,关于分布式的事务的相关话题,你可以看看《分布式系统的事务处理》一文。

(全文完)

(转载本站文章请注明作者和出处 酷 壳 – CoolShell ,请勿用于任何商业用途)

(173 人打了分,平均分: 4.54 )

(173 人打了分,平均分: 4.54 )

《缓存更新的套路》的相关评论

我也觉得有问题,内存里没有怎么判断dirty,而且既然是dirty应该不会未命中吧?

@i6941

这里使用的内存块可能是其他缓存对象使用的,重用内存块时要判断内存上的数据是否是“dirty”状态,如果是“dirty”,则写回存储,否则会丢数据。

应该是的。需要将“即将被换出缓存”数据块落地。

即将被换出缓存的脏数据块~

见过一种没有那么常规的pattern,在一些网站架构的实现中,会直接将lower memory的数据加载到缓存中的,并且进行定期的全量和增量的更新,不过这种只适用于那种对于缓存数据正确性要求没有那么高的场景的吧

宏观架构和计算机底层微观有很多相通之处,这个非常赞同!

不错的教程,支持一下!

问题是memory cache, OS可以掌握更多的信息,也不用考虑网络延迟和跨数据中心的问题。但是Redis+DB这种的情况,这些都要考虑,问题就要复杂很多。

mysql进行写操作时可以幻读,Cache Aside Pattern是不是会经常有脏数据缓存?应该如何解决?

确实,微观和宏观之间有些思想是相通的,设计模式是可以移植的

回顾好文

什么经济学,管理学在计算机里统统都有体现!

末位淘汰制度。“选、育、用、留”,不就像缓存么!

人类造的各种轮子,不就像寻找心中的永动机一样?

皓哥,我的微信订阅号发表了一篇“读《缓存更新的套路》有感”,其中主要是借鉴你的这篇文章,如果您觉得这种方式侵权了,我会删除的,谢谢

这么好的文章,必须要登陆顶一个啊!

先更新db,再更新cache。这种方式“怕两个并发的写操作导致脏数据。“,产生脏数据的原因是因为A先更新db,然后B再更新db,接着是B更新cache,最后才是A更新cache?也就是说A更新cache应该比B更新cache早才对,但是因为网络等原因,B却比A更早更新了cache。请问是否是由于这个原因导致了“两个并发的写操作导致脏数据”的发生。

“看到好些人在写更新缓存数据代码时,先删除缓存,然后再更新数据库,而后续的操作会把数据再装载的缓存中。然而,这个是逻辑是错误的。试想,两个并发操作,一个是更新操作,另一个是查询操作,更新操作删除缓存后,查询操作没有命中缓存,先把老数据读出来后放到缓存中,然后更新操作更新了数据库。于是,在缓存中的数据还是老的数据,导致缓存中的数据是脏的,而且还一直这样脏下去了。”这个不会一直脏下去吧?在文章刚开始的时候有提到说是会在删除缓存并更新完数据库后会重载缓存,所以个人觉得不会一直脏下去,只会在并发操作时造成部分脏数据,还请您多多指教

还是会, 比如a, b两个并发写操作, 这样的执行顺序

a db写 -> b db写 -> b cache写 -> a cache写

这时, cache里是a写的脏数据。

如果只是让cache失效, 则不会出现问题, 唯一的问题就是写入db后, 让cache失效前, cache里是“脏数据”, 然而如果把cache db当做一个整体, 参考事务隔离, 当前写入db, 而没有让cache失效的操作, 属于uncommit状态, 其他读就应该读到cache里的”脏数据”, 即old version, 当让cache失效后, 读才会读到最新version的数据。

“如果你要做好架构,首先你得把计算机体系结构以及很多老古董的基础技术吃透了” 大赞!

大神!你的这个更新顺序是建立在更新数据库,更新缓存都不会发生失败的情况下的,单独考虑并发问题得到的顺序!

方案1:先更新数据库,再删除缓存,当出现并发问题概率很小(假设概率为R1),会造成脏数据。当出现网络等问题导致删除缓存失败(假设概率为R2),会导致之后的请求一直是脏数据。

方案2:先删除缓存,再更新数据库,当出现并发问题概率较大(假设概率为R3),会导致之后的请求一直是脏数据,当出现网络问题,删除缓存成功,更新数据库失败,只会引发一次cache miss,在业务上基本没啥影响。当然为了弥补,我们一般都会设置缓存的过期时间,来缩短出现脏数据的时间。现在问题的关键就是R1+R2和R3的大小问题了,如果大厂,网络基础设施啥的比较牛,当然R1+R2<R3选择方案1比较合适,对于广大小厂来说还真的可能R1+R2>R3那怎么选择,就比较清楚了。

Cache Aside Pattern感觉有问题啊

一个更新请求:先更新DB,再使缓存失效。

一个读请求在更新请求更新DB之后,访问cache命中不是就数据么,然而这个时候DB已经是新的数据了。

感觉这个明显是缓存和DB里面数据不一致啊

不但知其然,还知其所以然,读完真是受益匪浅!老师,能不能专门推荐下你说的基础和老古董设计,我们需要补充哪些,有木有相关书籍可以介绍

应该是我学的还不够,Read/Write Through Pattern一点没明白。。。

而读操作必需在写操作前进入数据库操作,而又要晚于写操作更新缓存,所有的这些条件都具备的概率基本并不大。

这个,如果读操作是一个批量操作,那就会批量写缓存,时间会长一些,那么很有可能出发这个情况吧?